站长网近日消息,OpenAI 今日宣布,正建立 Preparedness 团队来评估通用 AI(Artificial General Intelligence,AGI)可能造成的灾难性风险,该团队交由麻省理工学院(MIT)的可部署机器学习中心主任 Aleksander Madry 主导。

▲ 图源 OpenAI

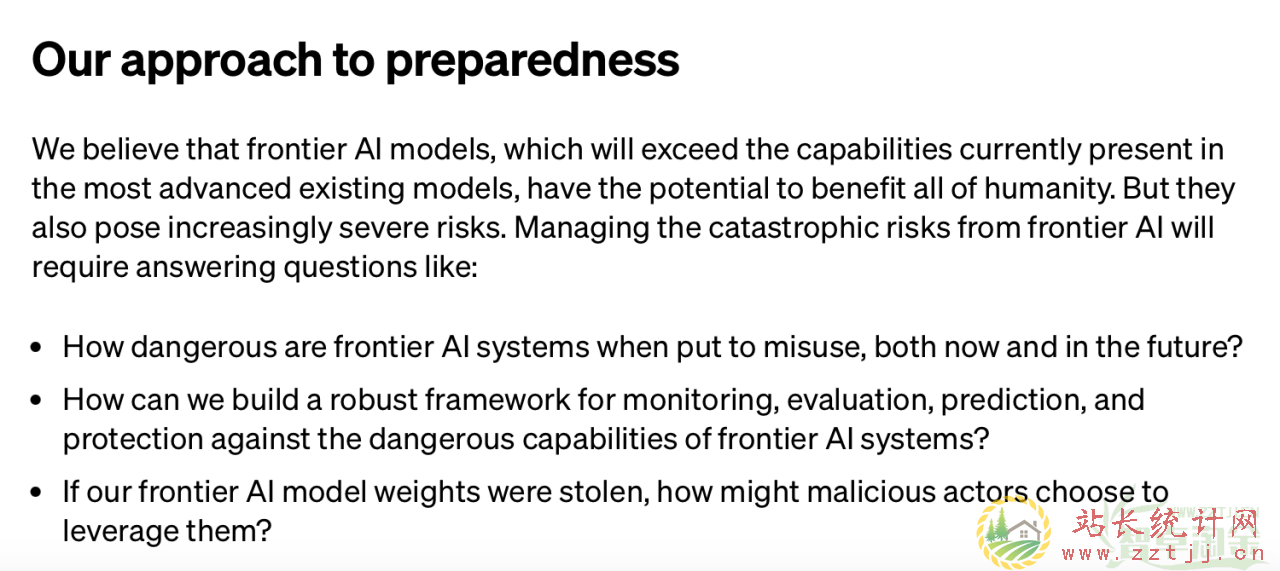

OpenAI 表示,未来的 AI 模型虽然拥有造福全人类的潜力,但也可能带来严重的风险,因此需要建立一个强大的框架来监控、评估、预测及防范这些 AI 模型。

据悉,OpenAI 设立了 Preparedness 团队,将针对各种 AI 模型进行能力评估及红队测试,以追踪、预测及防范各类别的灾难性风险。

站长网发现,OpenAI 宣称的相关风险,主要包含以下三大类:

说服人类能力:AI 输出的内容是否会影响人类的行为

生成不当内容:AI 是否会生成有关化学 / 生物 / 放射性 / 核(CBRN)等危险内容

自主复制与适应能力(Autonomous Replication and Adaptation,ARA):AI 是否会在自我迭代中脱离人类的控制

OpenAI 已开始招募不同背景的人才加入 Preparedness 团队,同时推出 AI Preparedness 挑战赛,鼓励参赛者以黑客名义,“破解”Whisper、Voice、GPT-4V、DALLE3 等模型,前 10 名将可获得 OpenAI 所提供的、价值 2.5 万美元(站长网备注:当前约 18.3 万元人民币)的 API 使用额度。

声明:本文内容采编自互联网,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容,请点击举报,一经查实,本站将立刻删除。